Nội dung chính

- 1 1. Multilayer Perceptron (MLP) – Mạng nơ-ron cổ điển nhưng nền tảng cho tất cả

- 2 2. Convolutional Neural Network (CNN) – Mô hình “vua” của xử lý ảnh

- 3 3. Recurrent Neural Network (RNN) – Mạng xử lý chuỗi cổ điển

- 4 4. LSTM – Long Short Term Memory (RNN nâng cấp)

- 5 5. GRU – Gated Recurrent Unit

- 6 6. Autoencoder – Nén dữ liệu và phát hiện bất thường

- 7 7. Variational Autoencoder (VAE) – Mô hình sinh dữ liệu

- 8 8. Generative Adversarial Network (GAN) – Mô hình tạo ảnh “như thật”

- 9 9. Transformer – Cuộc cách mạng Deep Learning

- 10 10. Vision Transformer (ViT) – Transformer cho xử lý ảnh

- 11 11. DETR – Mô hình phát hiện vật thể không cần anchor

- 12 12. RNN-Transducer & Conformer – Mô hình speech hiện đại

- 13 13. Graph Neural Network (GNN) – Mạng cho dữ liệu dạng đồ thị

- 14 14. Reinforcement Learning (Deep RL) – AI học bằng thưởng/phạt

- 15 15. Sequence-to-Sequence (Seq2Seq)

- 16 16. Encoder–Decoder Architecture

- 17 17. Siamese Network – Học tương đồng

- 18 18. U-Net – Chuẩn mực của phân đoạn ảnh y tế

- 19 19. LLaMA, GPT, Claude – Mô hình LLM hiện đại

- 20 20. Multimodal Models – AI đa phương thức (ảnh + video + text + âm thanh)

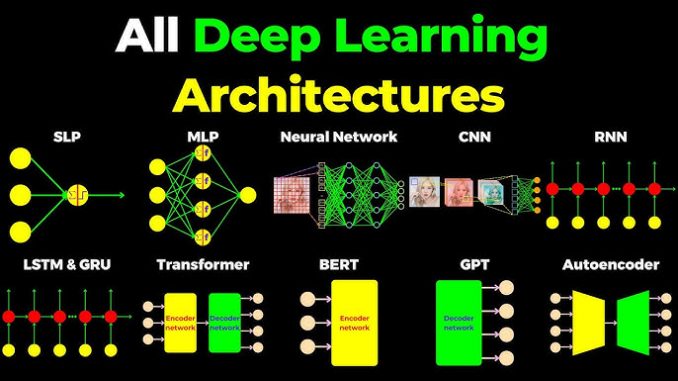

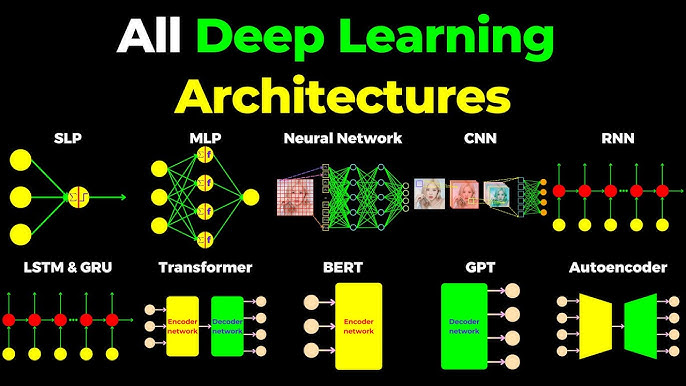

Deep Learning (học sâu) là một hệ sinh thái khổng lồ gồm nhiều kiến trúc mô hình khác nhau — mỗi kiến trúc phù hợp với một dạng dữ liệu và một mục tiêu khác nhau.

Nhiều người mới học AI chỉ biết đến “mạng nơ-ron” hoặc “mạng nhiều lớp”, nhưng thực tế, Deep Learning đã phát triển thành hàng chục kiến trúc tinh vi, giúp giải quyết mọi loại bài toán trong thế giới thật.

1. Multilayer Perceptron (MLP) – Mạng nơ-ron cổ điển nhưng nền tảng cho tất cả

Multilayer Perceptron là gì?

MLP hay mạng nơ-ron truyền thẳng (Feedforward Neural Network) là kiến trúc đầu tiên của Deep Learning. Nó gồm các lớp:

-

input layer

-

hidden layers

-

output layer

Mỗi neuron kết nối hoàn toàn với neuron lớp sau.

Khi nào dùng MLP?

Thường dùng cho dữ liệu dạng bảng (tabular data):

-

Dự đoán giá

-

Phân loại khách hàng

-

Dự báo doanh thu

-

Thẩm định tín dụng

Ví dụ thực tế:

Một công ty fintech muốn dự đoán khả năng vỡ nợ của khách hàng dựa vào:

-

thu nhập

-

lịch sử tín dụng

-

độ tuổi

-

nghề nghiệp

-

số dư tài khoản

→ MLP là lựa chọn chuẩn.

Ưu điểm:

-

Dễ hiểu, dễ triển khai

-

Chạy nhanh

-

Dền bỉ, dùng cho bài toán đơn giản

Nhược điểm:

-

Không phù hợp cho dữ liệu phức tạp: hình ảnh, chuỗi thời gian dài, âm thanh…

2. Convolutional Neural Network (CNN) – Mô hình “vua” của xử lý ảnh

CNN ra đời để xử lý dữ liệu không gian (spatial data), đặc biệt là ảnh 2D hoặc video.

Cách hoạt động:

CNN dùng các bộ lọc (kernel) để quét qua hình ảnh, trích xuất:

-

cạnh

-

góc

-

hình dạng

-

texture

-

pattern phức tạp

Qua nhiều lớp convolution, mô hình “thấy” được vật thể trong ảnh.

Khi nào dùng CNN:

-

Nhận diện hình ảnh

-

Phân loại đối tượng (cat/dog)

-

Phát hiện đối tượng (BBox)

-

Phân đoạn ảnh (segmentation)

-

Nhận diện khuôn mặt

-

Camera AI – giám sát an ninh

-

Chẩn đoán y khoa từ ảnh CT/MRI/X-ray

Ví dụ thực tế:

Một bệnh viện dùng CNN để phát hiện ung thư phổi từ ảnh X-quang.

CNN có thể phát hiện “dấu hiệu bất thường” mà mắt thường khó thấy.

Các biến thể hiện đại của CNN:

-

ResNet – khắc phục gradient vanishing

-

DenseNet – mỗi lớp kết nối toàn bộ

-

Inception – đa kích thước kernel song song

-

EfficientNet – tối ưu kích thước mô hình vs độ chính xác

3. Recurrent Neural Network (RNN) – Mạng xử lý chuỗi cổ điển

RNN được thiết kế để xử lý dữ liệu có thứ tự theo thời gian:

-

văn bản

-

âm thanh

-

chuỗi thời gian kinh tế

-

dữ liệu cảm biến IoT

Cách làm việc:

Mỗi bước thời gian nhận đầu vào mới và trạng thái ẩn (hidden state) từ bước trước.

Giống như “ghi nhớ ngắn hạn”.

Khi nào dùng:

-

Dự báo thời tiết

-

Phân tích cảm xúc (sentiment analysis)

-

Nhận dạng giọng nói

-

Dự đoán giá cổ phiếu

-

Chatbot đơn giản

Nhược điểm:

-

Rất khó học thông tin dài

-

Dễ xảy ra vanishing gradient

→ Vì vậy các mô hình mới hơn đã ra đời.

4. LSTM – Long Short Term Memory (RNN nâng cấp)

LSTM giúp khắc phục việc RNN “quên” thông tin.

Bí mật là 3 cổng:

-

Forget gate

-

Input gate

-

Output gate

Khi nào dùng LSTM:

-

Dịch tự động (MT)

-

Tổng hợp văn bản

-

Nhận diện giọng nói

-

Phân tích chuỗi tài chính

-

Dự đoán nhu cầu thị trường

Ví dụ:

Dự báo doanh thu 30 ngày tới dựa trên dữ liệu 3 năm → LSTM rất hiệu quả.

5. GRU – Gated Recurrent Unit

Nhẹ hơn LSTM nhưng độ chính xác tương đương.

Khi nào dùng GRU?

-

Khi dataset nhỏ

-

Khi cần tốc độ nhanh

-

Khi triển khai trên mobile/IoT

6. Autoencoder – Nén dữ liệu và phát hiện bất thường

Autoencoder gồm encoder + decoder, học cách nén dữ liệu xuống latent space.

Ứng dụng mạnh:

-

Giảm chiều dữ liệu

-

Khử nhiễu hình ảnh

-

Phát hiện anomaly (gian lận giao dịch ngân hàng)

-

Tái tạo ảnh

Ví dụ:

Ngân hàng dùng autoencoder phát hiện giao dịch bất thường:

→ giao dịch bất thường sẽ tái tạo kém → lỗi tái tạo cao → báo động.

7. Variational Autoencoder (VAE) – Mô hình sinh dữ liệu

VAE tạo ra hình ảnh mới giống dataset gốc.

Dùng trong:

-

Sinh dữ liệu mới (synthetic data)

-

Tăng cường dữ liệu y tế

-

Sinh mặt người

-

Tạo hình minh họa từ latent vector

8. Generative Adversarial Network (GAN) – Mô hình tạo ảnh “như thật”

GAN có 2 mạng:

-

Generator

-

Discriminator

Hai bên đấu nhau → tạo ra hình ảnh siêu chân thực.

Ứng dụng GAN:

-

Tạo ảnh người giả

-

Deepfake

-

Tạo phong cảnh

-

Nâng cấp ảnh cũ

-

Biến phong cách ảnh (style transfer)

-

Sinh dữ liệu huấn luyện

Biến thể GAN:

-

StyleGAN

-

CycleGAN

-

Pix2Pix

-

DCGAN

-

WGAN

9. Transformer – Cuộc cách mạng Deep Learning

Transformer thay thế RNN trong NLP nhờ cơ chế Attention.

Lợi thế:

-

Học song song

-

Hiểu ngữ cảnh dài

-

Hiệu quả với dữ liệu lớn

-

Scalable cực mạnh

Ứng dụng:

-

ChatGPT

-

Google Translate mới

-

Tóm tắt văn bản

-

Viết kịch bản video

-

Phân loại nội dung

-

Chatbot doanh nghiệp

Các mô hình Transformer:

-

BERT

-

GPT

-

T5

-

XLNet

-

RoBERTa

10. Vision Transformer (ViT) – Transformer cho xử lý ảnh

ViT cắt ảnh thành các “patch”, biến mỗi patch thành token giống NLP → Transformer xử lý.

Tác dụng:

-

Nhận diện ảnh

-

Phân loại hình ảnh

-

Phát hiện vật thể

-

KHẢ NĂNG VƯỢT MẶT CNN ở dataset lớn

11. DETR – Mô hình phát hiện vật thể không cần anchor

DETR dùng Transformer để trực tiếp dự đoán bounding box.

Ưu điểm:

-

Kiến trúc đơn giản

-

Không cần anchor box

-

Chính xác hơn

-

Training dễ

Ứng dụng:

-

Camera giao thông

-

Nhận diện biển báo

-

Giám sát an ninh

-

Đếm người, đếm xe

12. RNN-Transducer & Conformer – Mô hình speech hiện đại

Dùng cho:

-

nhận diện giọng nói realtime

-

call center AI

-

subtitle AI

-

trợ lý ảo

Conformer (convolution + transformer) là mô hình SOTA hiện nay.

13. Graph Neural Network (GNN) – Mạng cho dữ liệu dạng đồ thị

Khi dùng GNN:

-

Mạng xã hội (Facebook Friend Recommendation)

-

Gợi ý sản phẩm (Graph Collaborative Filtering)

-

Dự đoán phân tử trong y học

-

Phát hiện gian lận tài chính theo mạng giao dịch

14. Reinforcement Learning (Deep RL) – AI học bằng thưởng/phạt

Mô hình RL nổi bật:

-

DQN

-

PPO

-

A3C

-

SAC

Ứng dụng:

-

Game (AlphaGo, AlphaZero)

-

Robot tự học

-

Xe tự lái

-

Tối ưu hóa kho vận

15. Sequence-to-Sequence (Seq2Seq)

Tiền thân của Transformer.

Ứng dụng:

-

Dịch máy

-

Tạo tóm tắt

-

Viết chú thích ảnh

16. Encoder–Decoder Architecture

Cốt lõi của rất nhiều mô hình NLP và Vision.

Dùng ở:

-

Tóm tắt

-

Dịch

-

Sinh text

-

Image captioning

17. Siamese Network – Học tương đồng

Dùng để:

-

Nhận diện khuôn mặt (FaceID)

-

Tìm kiếm văn bản tương đồng

-

Xử lý matching sản phẩm trong thương mại điện tử

18. U-Net – Chuẩn mực của phân đoạn ảnh y tế

Ứng dụng cực rộng trong y tế:

-

phân đoạn tế bào

-

phân đoạn khối u

-

phân đoạn xương

-

phân đoạn mạch máu

19. LLaMA, GPT, Claude – Mô hình LLM hiện đại

Nói về:

-

Mô hình tập trung vào NLP

-

Kiến trúc Transformer

-

Pre-training vs Fine-tuning

-

RAG (Retrieval-Augmented Generation)

-

Ứng dụng LLM trong doanh nghiệp

20. Multimodal Models – AI đa phương thức (ảnh + video + text + âm thanh)

Ví dụ:

-

GPT-4

-

Gemini

-

Claude 3

-

LLaVA

-

Flamingo

Ứng dụng:

-

Trợ lý AI hiểu hình ảnh

-

Báo cáo y tế từ ảnh CT

-

AI đọc chứng từ kế toán

-

AI cho camera giao thông

-

Video QA

Series 5 bài viết tổng quan về AI cho người mới hoàn toàn

(Bài 1) Trí Tuệ Nhân Tạo (AI) Là Gì? – Kiến thức dành cho người mới

(Bài 2) Machine Learning là gì?

Be the first to comment